Stephen Hawking fala sobre seus medos em relação à inteligência artificial

Stephen Hawking está sempre fazendo declarações sobre as principais paranoias que rondam o mundo tecnológico. No início do mês passado, publicamos sobre seu posicionamento de que a humanidade teria cerca de seis séculos para encontrar novos planetas para fixar residência. Em julho, ele já havia abordado a importância de se enviar astronautas à lua antes de 2020, de se construir uma base lunar nos próximos trinta anos e colonizar Marte até 2025. Essas duas opiniões emitidas por Hawking concordam com o que ele já tinha dito há um ano sobre a humanidade não ter muito mais que um milênio de vida no planeta Terra.

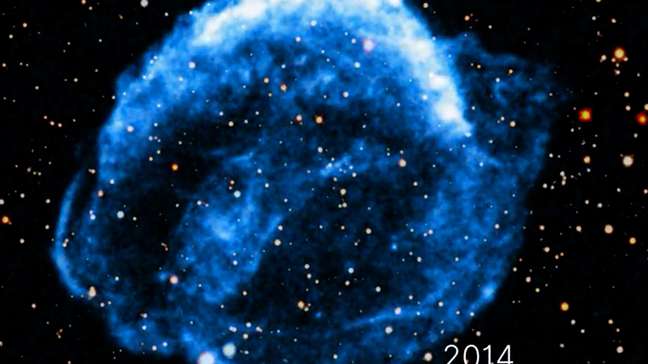

Agora, em entrevista para a Wired, o gênio retomou o tema das declarações que ele havia feito em 2014 sobre os perigos envolvidos no desenvolvimento da tecnologia de inteligência artificial. Ãquela ocasião, Hawking afirmou que "essa seria a maior conquista da humanidade até então e possivelmente a última".

Em carta enviada, também em 2014, para o The Independent, o físico falou: "As máquinas poderão manipular mercados financeiros, seres humanos, desenvolver armas que nós não poderíamos entender e provavelmente provocariam o fim da nossa espécie se não aprendermos a controlar os danos. Então, encarando os possíveis futuros com benefícios e riscos incalculáveis, os especialistas estão fazendo tudo que está ao alcance deles para garantir o melhor resultado, certo? Não é bem assim. Pouquíssimas pesquisas de contra medidas são desenvolvidas e levadas a sério fora de institutos não lucrativos como o Centro de Estudo de Riscos Existenciais de Cambridge, o Instituto do Futuro da Humanidade, o Instituto de Pesquisas de Inteligência das Máquinas e outros similares. A questão é que todos nós deveríamos pensar um pouco mais a respeito dessa questão. Será que se criássemos inteligência artificial e essa inteligência decidisse viver, o desejo de viver seria algo irrelevante, pré-programado, mesmo que involuntariamente, ou algo espontâneo a ser respeitado? E o que as máquinas achariam disso?"

O assunto dá pano para a manga. E, frente aos avanços que a robótica e a inteligência artificial vêm alcançando, Hawking voltou a abordar o assunto na entrevista mais recente e falou, entre outros assuntos, sobre o medo dos perigos em potencial da IA: "O gênio saiu da garrafa. Nós precisamos seguir adiante no desenvolvimento de inteligência artificial mas também precisamos ser conscientes dos seus reais perigos. Eu temo que a IA talvez venha a substituir a humanidade. Se as pessoas desenvolvem vírus de computador, alguém vai desenvolver IA que replica a si mesma. Esta será uma nova forma de vida que superará os humanos".

-veynamezslrs.jpg)